Tomado de xataka

Unos investigadores del International Institute of Information Technology en Hyderabad, India, han desarrollado un sistema de inteligencia artificial capaz de crear vídeos deepfakes traducidos a diferentes idiomas. No hablamos solo de «audio», es decir, de que el sujeto primero hable inglés y luego hable en español, sino que el software usa inteligencia artificial para emular el movimiento de los labios para arrojar un resultado más realista.

Dicha aproximación ha sido bautizada como «Face-to-Face Translation» y, de acuerdo a Prajwal Renukanand, autor principal del estudio, «a medida que la comunicación digital de hoy en día se vuelve cada vez más visual, argumentamos que existe la necesidad de sistemas que puedan traducir automáticamente un vídeo de una persona que habla en el idioma A a un idioma B con una sincronización labial realista». Veamos cómo funciona.

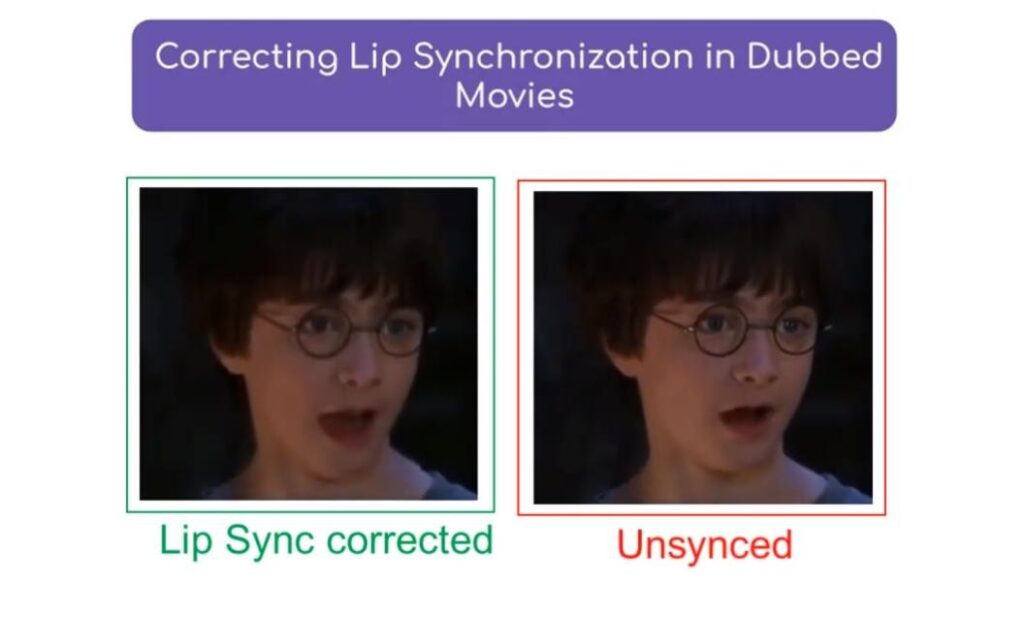

Para desarrollar su modelo, los investigadores crearon un sistema de traducción de voz a voz reuniendo diferentes módulos existentes de voz y lenguaje. Posteriormente, implementaron LipGAN para hacer la «traducción cara a cara». LipGAN, como casi se puede intuir de su nombre, es un sistema para generar rostros realistas a partir del audio que «hablan» dicho audio con los labios sincronizados.

El sistema se divide en dos subsistemas: traducción de voz a voz y síntesis de labios. El primero combina tecnologías como ASR (reconocimiento automático del habla, por sus siglas en inglés), NMT (traducción automática neuronal) y TTS (Text-to-Speech) para, primero, entender lo que dice el audio original; segundo, traducirlo a otro idioma y tercero, «hablarlo» en el idioma objetivo usando la voz del sujeto. Para traducir el inglés se ha usado DeepSpeech y para entrenar el sistema NMT en los idiomas indios se ha usado el código base de Facebook AI Research.

El segundo subsistema es la síntesis del rostro del sujeto. Para ello se ha desarrollado LipGAN, un modelo que puede generar rostros parlantes de cualquier persona a partir de cualquier fragmento de audio. El modelo consta de dos codificadores: un codificador facial y un codificador de voz. El primero se usa para «codificar información sobre la identidad del sujeto», tal y como explican los autores, mientras que el segundo «toma fragmentos de voz muy pequeños (350 ms de audio por fragmento) y los usa para codificar la información de audio». Finalmente, el output de estos dos codificadores se introduce en un decodificador que genera una imagen facial con los labios sincronizados con el fragmento de audio.

Básicamente, LipGAN es una red generativa antagónica. El generador crea una imagen facial condicionada por el input de audio y el discriminador comprueba que los frames generados y el audio están sincronizados de la mejor forma posible. Para conseguirlo, además de con imágenes sintetizadas, el modelo ha sido alimentado con otras muestras sincronizadas y no sincronizadas para aprender a detectar la mejor sincronización labial, además de la calidad de imagen óptima.

Finalmente, el sistema fue sometido a dos evaluaciones. En la cuantitativa se usaron los métodos PSNR (Proporción Máxima de Señal a Ruido), SSIM(Índice de Similitud Estructural) y LMD (Landmark Distance) y se enfrentó LipGAN a otros modelos similares, consiguiendo LipGAN la mejor puntuación en todos ellos. En la humana, 20 personas evaluaron el realismo y la sincronización labial de 150 ejemplos en una escala de uno a cinco y, de nuevo, LipGAN se llevó la puntuación más alta.

De acuerdo a los investigadores, y si bien el software no es lo suficientemente rápido para hacer esta traducción en tiempo real, LipGAN tiene potencial para el doblaje de películas, de vídeos educativos y para entrevistas y noticias en la televisión. «Por ejemplo, un espectador hindi o alemán podría ver una entrevista a Obama en su idioma con su propia voz y con los labios sincronizados», afirman los autores del estudio.

No es la primera vez que los deepfakes se ponen sobre la mesa como una alternativa para la animación en las películas. Uno de los ejemplos más recientes es ‘Gémini’, una película en la que Will Smith se enfrenta a una copia digital de sí mismo 30 años más joven. Se estima que la creación de este Will Smith más joven ha costado entre medio millón y un millón de dólares, más 100.000 dólares por cada escena, aunque el Financial Timesestima que el coste total de este «doble virtual» ha sido de 25 millones de dólares.

Con una GAN (red generativa antagónica) bien entrenada, el coste de este tipo de activos se reduciría drásticamente. Es a lo que Peter Rojas, de Betaworks Ventures, se refiere con «la democratización de los efectos especiales». Darren Hendler, de VFX House, cree que lo visto en ‘Gémini’ y ‘El Irlandés’ serán los últimos modelos 100% digitales de humanos que no usen algún tipo de GAN, lo que lleva a una segunda predicción. «comenzaremos a ver esta clase de cosas en producciones de menor presupuesto».